项目代码:https://github.com/TiffanyBlews/MozartsTouch (求star!)

论文地址:https://arxiv.org/abs/2405.02801 (已被 AIGC2024 收录)

展示页面:https://tiffanyblews.github.io/MozartsTouch-demo/

详情请参见论文原文。

引言:当视觉遇见音乐

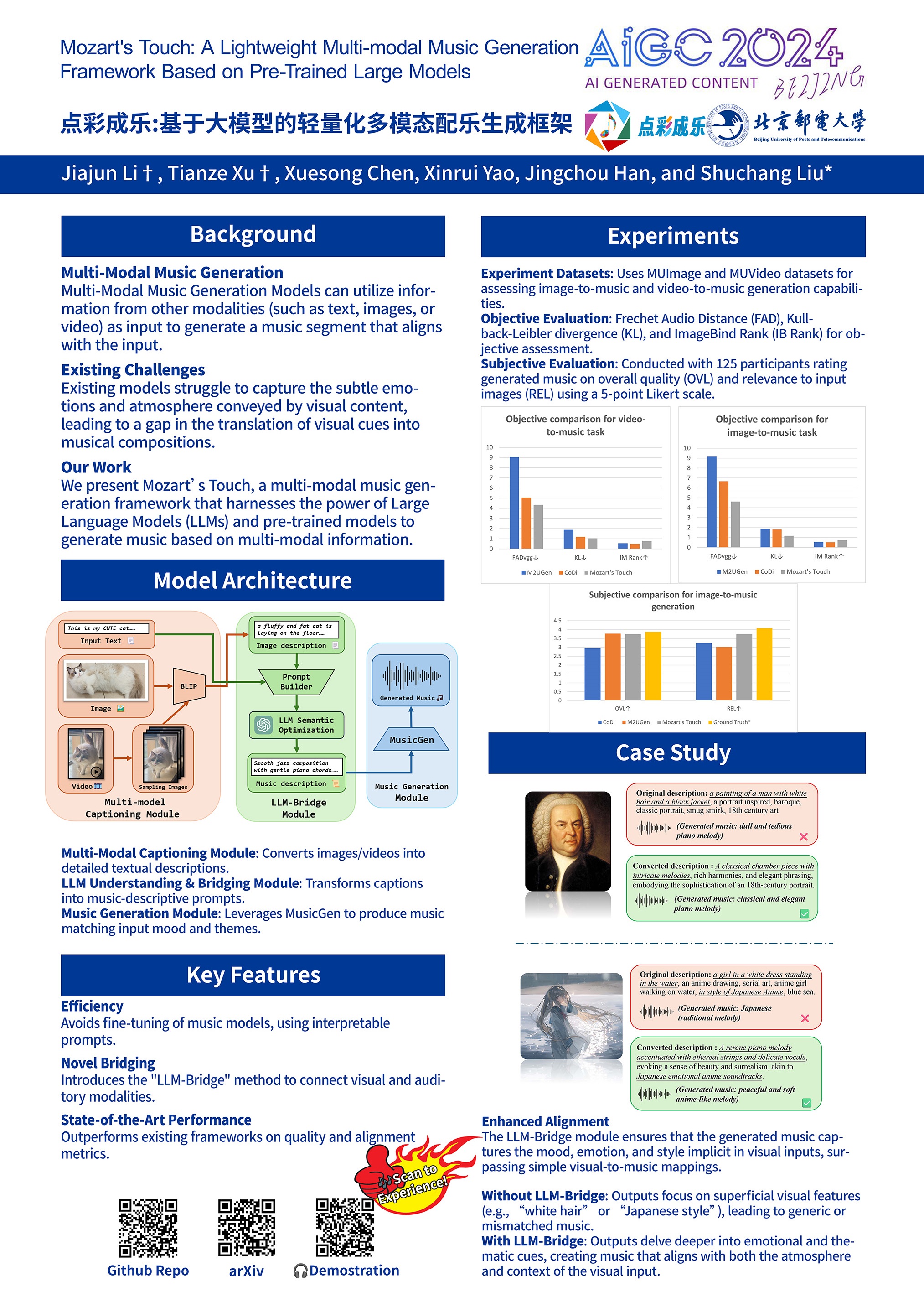

近年来,AI生成内容(AIGC)在艺术创作领域发展迅猛,但现有模型在图像/视频到音乐的跨模态生成任务中仍面临关键挑战:生成的音乐往往难以精准捕捉视觉内容传递的情感和氛围。例如,一张描绘“暴风雨中的灯塔”的图像,生成的音乐可能仅停留在“激昂”的层面,而忽略了孤独、希望等细腻情感。

为此,“点彩成乐”团队提出了一种轻量级多模态音乐生成框架——Mozart’s Touch。该框架通过大语言模型(LLM)桥接视觉与听觉,无需训练新模型即可生成与输入高度对齐的音乐,在质量与效率上均超越现有方法。

框架核心:三模块协作

Mozart’s Touch由三个模块串联构成,形成从视觉输入到音乐输出的完整流程:

1. 多模态描述生成模块

- 输入处理:支持图像或视频输入。

- 图像:直接通过BLIP模型生成文本描述。

- 视频:先采样关键帧生成单帧描述,再通过LLM聚合为整体视频描述。

- 关键技术:使用ViT和BLIP模型提取视觉特征并生成自然语言描述,确保对视觉内容的精准理解。

2. LLM理解与桥接模块

- 核心任务:将视觉描述转换为音乐生成所需的提示词(Prompt)。

- 挑战:视觉描述(如“城堡、黄昏”)需转化为音乐属性(如“史诗感、管弦乐”)。

- 解决方案:

- 通过LLM解析视觉描述中的情感、主题与风格。

- 引入“桥接提示模板”(如指定音乐流派、情绪关键词),确保生成的提示词兼具创造性和结构性。

3. 音乐生成模块

- 基于预训练模型MusicGen,根据LLM生成的提示词生成音乐。

- 优势:直接调用现成模型,无需额外训练,兼顾效率与质量。

技术亮点:LLM-Bridge如何突破模态鸿沟?

传统多模态方法依赖端到端训练,存在模型臃肿、可解释性差的问题。Mozart’s Touch创新性地提出LLM-Bridge方法,利用大语言模型的语义理解能力,解决视觉与音乐模态的异质表示问题:

- 语义对齐:将视觉描述中的“画面元素”映射为“音乐属性”。

- 例如,图像描述“海滩上的日落” → 音乐提示“轻快的尤克里里旋律,搭配海浪声,BPM 90,风格:休闲流行”。

- 动态约束:通过提示模板强制指定音乐流派、情绪标签等,提升生成可控性。

- 轻量化设计:无需微调LLM或音乐模型,仅通过提示工程实现跨模态对齐,显著降低计算成本。

实验结果:领先SOTA

团队在MUImage(图像-音乐)和MUVideo(视频-音乐)数据集上进行了评测,对比基线包括CoDi和M²UGen:

客观指标

- FAD(音频质量):Mozart’s Touch在图像任务中FAD=4.625,视频任务中FAD=4.339,均优于基线模型。

- IB Rank(跨模态对齐):图像任务IB Rank=0.753,视频任务IB Rank=0.787,显著高于其他模型,证明其生成的音乐与视觉内容高度相关。

主观评估

- 125名参与者对生成音乐的质量(OVL)和相关性(REL)打分:

- 在相关性(REL)上,Mozart’s Touch(3.76)远超M²UGen(3.02),接近真实音乐(4.08)。

- 在质量(OVL)上,Mozart’s Touch(3.74),接近SOTA模型M²UGen(3.77)。

案例展示

案例显示,LLM-Bridge模块能有效避免“视觉关键词干扰”,例如巴赫肖像生成的音乐更偏向巴洛克风格而非单纯“古典”。

应用场景与未来展望

- SNS配乐:根据社交媒体用户分享的视频片段(如微信朋友圈视频)自动生成配乐。

- 影视配乐:根据视频片段自动生成贴合剧情的背景音乐。

- 游戏开发:为场景或角色动态生成主题曲。

- 艺术创作:辅助音乐人从视觉灵感中快速生成草稿。

未来,团队计划优化提示策略、提升模型性能与速度,并进一步提升生成音乐的多样性与情感深度。

结语

Mozart’s Touch通过LLM桥接视觉与音乐,为多模态生成任务提供了一种高效、轻量的解决方案。其“即插即用”的设计理念,不仅降低了计算门槛,也为AI面向大众的应用开辟了新方向。正如项目slogan所言:

“生活里的所有人,都是音乐家。”